最近、社内でも「ChatGPTで議事録の要約をしている」「会計仕訳のたたき台をAIに作らせた」という話をよく聞くようになりました。便利な一方で、総務・経理担当者として正直なところ「その情報、AIに入れて大丈夫だったの?」とヒヤリとする場面も増えてきています。

個人情報保護委員会も2023年6月に生成AI利用への注意喚起を出していて、AIに入れていい情報・ダメな情報の線引きは、もはや総務・経理担当者の必修科目になりつつある気がします。

今回は、生成AI(ChatGPT・Gemini・Claude)に渡してはいけない情報の整理と、各サービスの学習設定オプトアウト手順、そして社内ルール作りのポイントまで、担当者目線でまとめてみました。

総務・経理こそ生成AI利用に要注意!その理由とは

ChatGPTやGemini、Claudeなどの生成AIは、業務効率化の強い味方です。メールの文面作成や議事録の要約、会計処理の補助など、経理・総務でも活用の幅が広がっています。

しかし、便利だからといって何でもAIに入力してよいわけではありません。とくに経理・総務は、会社の中でもっとも機密性の高い情報を日常的に扱う部門です。使い方を間違えると、取り返しのつかない情報漏洩につながるリスクがあります。

なぜ経理・総務はとくに注意が必要なの?

経理部門は、未公開の売上データや取引先情報、銀行口座番号、請求書の明細など、会社の財務の根幹にかかわる情報を取り扱います。総務・人事部門も同様に、従業員の氏名・住所・電話番号・マイナンバー・給与情報・家族構成など、個人情報の中でもとくに機微な情報を日々扱っています。

これらの情報は、個人情報保護法や会社法、金融商品取引法などによって厳格に管理が義務づけられているものです。万が一漏洩すれば、法令違反や損害賠償、社会的信用の失墜につながりかねません。

会社全体の情報管理ルールと、AIへの入力ルールはセットで考えるのが安心ですね。社内の情報漏洩対策の全体像については、別記事でも整理しています。

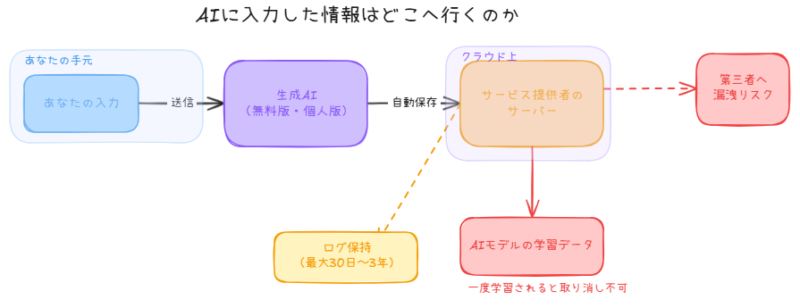

AIに渡した情報は本当に「一生残る」の?

生成AIに入力した情報のリスクで見落とされがちなのが、「一度渡した情報は完全には取り消せない」という点です。

多くの生成AIサービスでは、無料版の初期設定(デフォルト)のまま使うと、入力した内容がAIモデルの学習データとして利用されます。一度学習に組み込まれたデータは、たとえ後から設定を変更しても取り消すことはできない、と思っておいた方がいいです。

また、情報提供をユーザーが拒否するオプトアウト設定後もシステム上のログとして一定期間(ChatGPTは最大30日、Geminiは最大72時間)データが保持されます。さらに、サービス提供側のバグや事故によって、過去の入力内容が第三者に閲覧されるリスクもゼロではありません。

【ポイント】

「AIに渡した情報はインターネットに公開したのと同じ」くらいの意識を持つことが大切だと思います。紙の書類ならシュレッダーにかけられますが、デジタルデータは一度流出すると完全に回収することはできません。

ChatGPTのデータ保持、最近どうなってるの?(NYT訴訟の話)

ChatGPTのデータ保持期間について、最近少しややこしい動きがあったので触れておきます。

2025年5月、ニューヨーク・タイムズがOpenAIに対して起こした著作権訴訟の中で、裁判所が「OpenAIはChatGPTの全会話ログを無期限に保持せよ」という保全命令を出しました。これにより、本来30日で削除されるはずだった会話履歴も、一時的にすべて保管される状態になっていました。

この保全命令は2025年9月26日で終了し、ChatGPTは現在「削除した会話・一時的なチャットは30日以内に削除」という通常運用に戻っています。ただし、2025年4月〜9月分の履歴はOpenAIが今も保管中で、2026年1月には2,000万件のログをNYT側に提出する命令が確定しました(個人特定情報はマスキングされる予定です)。

ChatGPT Enterprise・Edu、ゼロデータ保持契約のあるAPI利用は対象外です。とはいえ「個人や中小企業の無料・有料アカウントは、訴訟次第でデータの扱いが変わりうる」という事実は、覚えておいた方がいいですね(だからこそマイナンバー級の情報は最初から入れない、が基本になります)。

実際に起きた情報漏洩事例

「うちの会社は大丈夫」と思う方もいるかもしれません。しかし、世界的な大企業でも生成AI経由の情報漏洩は実際に起きています。

事例①:サムスン電子 — ソースコード・会議録が漏洩(2023年)

韓国のサムスン電子では、半導体部門でChatGPTの使用を許可してから、わずか約20日間で3件の機密情報漏洩が発生しました。

漏洩内容は、半導体設備の測定データベースのソースコードを入力してエラー修正を依頼したケース、歩留まり・不良設備把握プログラムのコードを最適化依頼したケース、さらに社内会議の録音データをテキスト化してChatGPTに議事録作成を依頼したケースの3件です。

入力データがAIの学習データに取り込まれたことが問題視され、同社は最終的に生成AIの社内利用を全面禁止としました。許可してから20日でこの状態というのは、結構衝撃的な数字ですね。

事例②:Amazon — 社内機密と酷似する出力が発覚(2023年)

Amazonでは、社員がChatGPTにコードや機密情報を入力した結果、ChatGPTの出力にAmazon社内の機密データと酷似する内容が確認されました。顧問弁護士が社員向けに「ChatGPTに機密情報を入力しないように」との通達を出す事態に発展しています。

事例③:ChatGPTのバグで個人情報が他人に表示(2023年3月)

OpenAI自身のシステムバグにより、ChatGPT Plus利用者の個人情報が約10時間にわたり他のユーザーから閲覧可能な状態になりました。他ユーザーのチャット履歴のタイトルが表示されたほか、Plus加入者の約1.2%について氏名・メールアドレス・クレジットカード番号の下4桁などが閲覧可能になっています。

事例④:ChatGPTアカウント情報がダークウェブに大量流出(2023年〜2025年)

セキュリティ企業Group-IBの調査により、マルウェアに感染した端末からChatGPTのログイン情報が大量に窃取され、ダークウェブで取引されていることが判明しました。10万件超のアカウント情報が漏洩し、日本からも661件の流出が確認されています。2025年2月にも2,000万件規模の認証情報流出が報告されました。

アカウントが乗っ取られれば、過去のチャット履歴(業務で入力した機密情報を含む)がすべて第三者に閲覧されるリスクがあります。これも結構怖い話ですね。

事例⑤:リートン — ユーザー情報が外部から閲覧可能に(2024年)

日本法人が運営する対話型生成AIサービス「リートン」でも、データベースの設定不備により、ユーザーのニックネーム・入力プロンプト・メールアドレス・LINE IDが外部から閲覧・編集可能な状態だったことが判明しています。

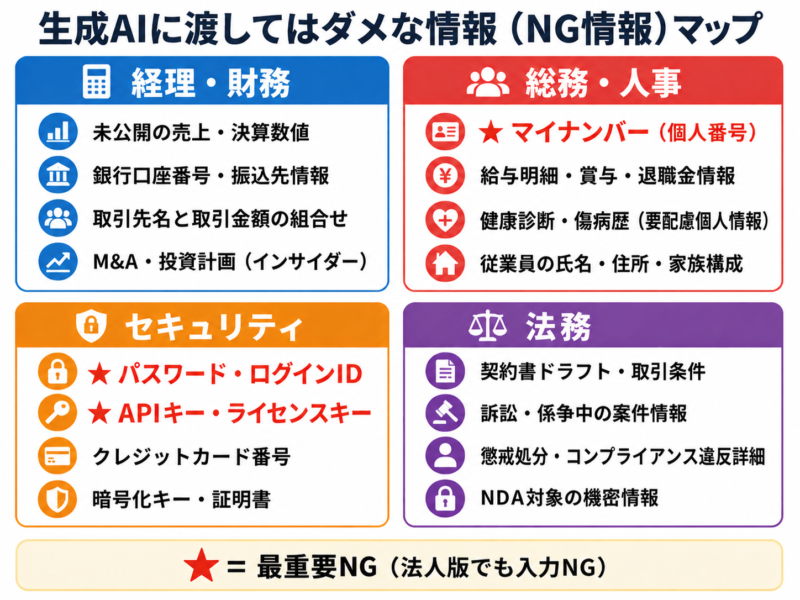

絶対にAIに入力してはいけない情報一覧

では具体的に、どのような情報をAIに入力してはいけないのでしょうか。経理・総務が扱う情報を中心に、絶対にNG(入力禁止)な情報を一覧にまとめてみました。

経理・財務でAIに渡すとアウトな情報?

- 未公開の売上高・利益率・決算数値

- 取引先名と取引金額の組み合わせ

- 銀行口座番号・振込先情報

- 請求書番号・発注番号(取引特定につながる情報)

- 資金繰り表・キャッシュフロー予測

- M&Aや投資計画に関する情報(インサイダー情報)

総務・人事でAIに入れちゃダメな情報?

- 従業員の氏名・住所・電話番号・生年月日

- マイナンバー(個人番号)

- 給与明細・賞与額・退職金の情報

- 扶養家族の情報

- 健康診断結果・傷病歴(要配慮個人情報)

- 採用応募者の履歴書・個人情報

セキュリティ・法務まわりでAIに入れたら危ない情報は?

- 各種システムのログインID・パスワード

- APIキー・ライセンスキー

- 契約書のドラフト・取引条件の詳細

- 訴訟・係争中の案件情報

- 社内の懲戒処分・コンプライアンス違反の詳細

パスワードの取り扱いは、AI以前の社内ルールとも関わる話です。「忘れたから誰かに聞く」「メモに書いて貼っておく」も含めて整理しておくと安心ですね。

社内PCや業務システムのパスワードを忘れたときの安全な復旧手段

カテゴリ別NG情報の早見表

| カテゴリ | NG情報の例 | リスク |

|---|---|---|

| 経理・財務 | 未公開決算数値、口座番号、取引先・金額 | インサイダー取引、不正アクセス |

| 総務・人事 | マイナンバー、給与情報、健康診断結果 | 個人情報保護法違反、プライバシー侵害 |

| セキュリティ | パスワード、APIキー、ライセンスキー | 不正ログイン、システム侵害 |

| 法務 | 契約書ドラフト、訴訟案件情報 | 秘密保持義務違反、訴訟リスク |

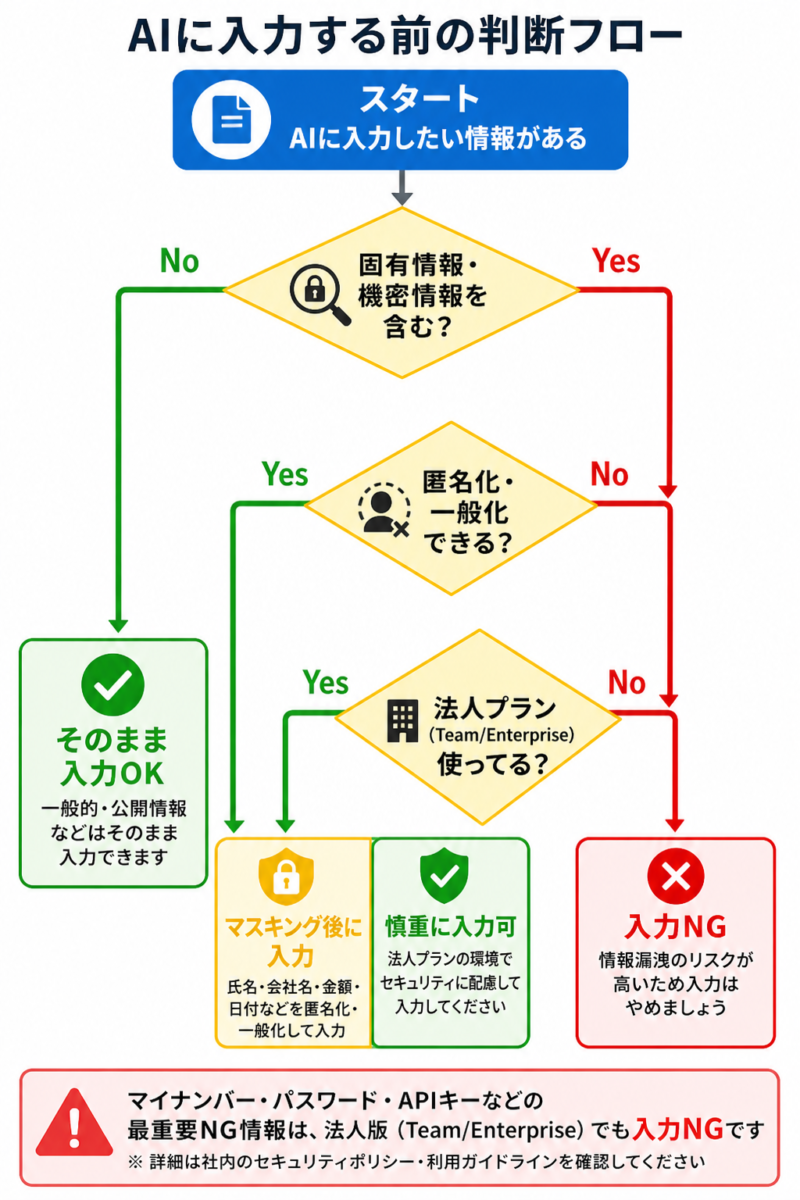

安全に使うための3つのテクニック

「じゃあ生成AIは使えないの?」と思うかもしれませんが、そんなことはありません。入力の仕方を工夫すれば、機密情報を守りながらAIの力を活用できます。ここでは、すぐに実践できる3つのテクニックを紹介します。

テクニック①:固有名詞を伏せて入力(マスキング)

固有名詞や具体的な数値を伏せてから入力する方法です。最も基本的かつ効果的なテクニックですね。

| NG例(そのまま入力) | OK例(匿名化して入力) |

|---|---|

| 株式会社ABCの売上高が5億5,000万円で… | A社の売上高がXX億円で… |

| 田中太郎さん(マイナンバー:1234…)の扶養控除を確認したい | ある従業員の扶養控除の計算方法を教えて |

| 三井住友銀行 渋谷支店 普通 1234567に振込処理を… | 振込処理の仕訳方法を教えて |

テクニック②:具体例ではなく「一般論」で聞く

具体的なケースをそのまま聞くのではなく、「一般的なケース」として質問する方法です。

| NG例(具体的すぎる) | OK例(一般化して質問) |

|---|---|

| 当社の今期売上3億円に対する法人税の計算をして | 売上3億円規模の中小企業の法人税の計算方法を教えて |

| 佐藤さんの年収420万円で甲欄の税額を計算して | 年収420万円の場合の甲欄・乙欄それぞれの源泉徴収税額の違いは? |

テクニック③:法人向けプラン(Enterprise / Workspace)を使う

どうしても業務で具体的な情報を入力する必要がある場合は、各AIサービスの法人向けプランを検討しましょう。法人向けプランでは、入力データがモデルの学習に使用されないことが契約上保証されています。

| AIサービス | 法人向けプラン | データ学習 |

|---|---|---|

| ChatGPT | ChatGPT Team / Enterprise | デフォルトで学習OFF |

| Gemini | Google Workspace(Gemini Business / Enterprise) | 学習に利用されない |

| Claude | Claude Team / Enterprise | デフォルトで学習OFF |

| Microsoft Copilot | Copilot for Microsoft 365 | 学習に利用されない |

【実務での注意点】

法人プランを導入しても安心しきってはいけません。従業員が個人の無料アカウントで業務利用する「シャドーAI」が最大のリスクです。個人アカウントはデフォルトで学習がONのため、管理者の目が届かない場所で情報漏洩が起こりえます。法人プランの導入と合わせて、個人アカウントでの業務利用を明確に禁止するルール作りも重要ですね。

【ChatGPT編】学習・情報の取扱設定を確認しよう

ここからは、主要な生成AIサービスごとに「学習させない設定」と「過去データの削除方法」を具体的に解説します。まずは最も利用者の多いChatGPTからです。

無料版と法人版でデータの扱いはどう違う?

| プラン | 学習利用(デフォルト) | オプトアウト |

|---|---|---|

| Free(無料版) | ON(学習に利用される) | 手動で設定変更が必要 |

| Plus / Pro | ON(学習に利用される) | 手動で設定変更が必要 |

| Team | OFF(学習に利用されない) | 設定不要 |

| Enterprise | OFF(学習に利用されない) | 設定不要 |

| API | OFF(学習に利用されない) | 設定不要 |

つまり、無料版やPlus/Proを使っている場合は、自分で設定を変更しない限り、入力した内容がAIの学習に使われます。ここは多くの方が見落としているポイントだと思います。

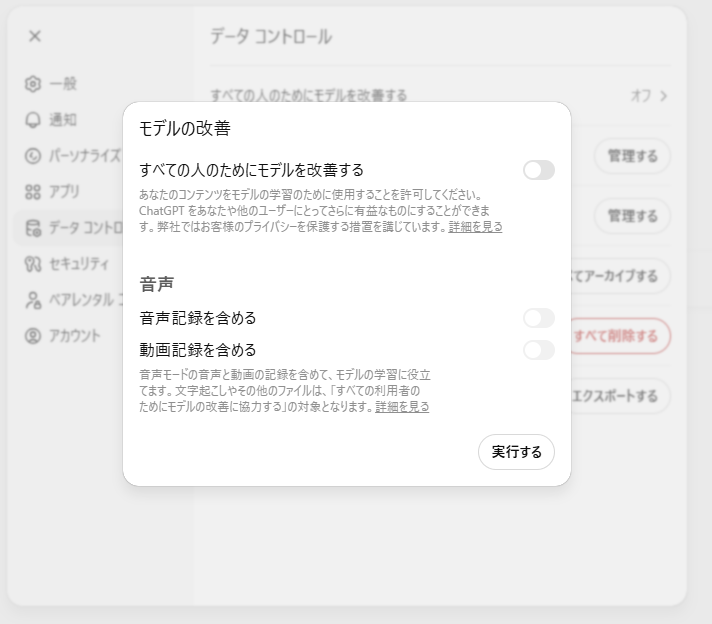

学習させない設定(オプトアウト)はどうやる?

以下の手順でオプトアウト設定を行います。

- ChatGPTにログインし、プロフィールアイコンをクリック

- メニューから「Settings(設定)」を選択

- 左側メニューの「Data Controls(データコントロール)」をクリック

- 「Improve the model for everyone(すべての人のためにモデルを改善する)」のトグルスイッチをOFFにする

- 「実行する」ボタンをクリックして設定完了

過去の会話履歴はどうやって消すの?

オプトアウト設定だけでは、過去に入力した情報は保護されません。すでに入力してしまった機密情報がある場合は、会話履歴の削除も併せて行いましょう。

- 「Settings(設定)」→「Data Controls(データコントロール)」を開く

- 「すべてのチャットを削除する」の項目を確認、実行

より確実にオプトアウトしたい場合は、OpenAIの公式プライバシーリクエストポータル(https://privacy.openai.com/)からデータ削除の申請を行う方法もあります。

オプトアウト後もデータが残る期間と注意点

- オプトアウト設定後も、ログとして最大30日間はOpenAIのサーバーにデータが保持されます(学習には使用されません)

- 設定変更前に入力したデータは、すでに学習に使用されている可能性があります

- UIのアップデートで設定画面の項目名や場所が変わることがあるため、定期的に確認しましょう

【Gemini編】学習・情報の取扱設定を確認しよう

Google のGeminiも、ChatGPTと同様にデフォルト設定のまま使うと入力データが学習に利用されます。Googleアカウントと連携しているため、設定方法はやや独特ですね。

無料版とGoogle Workspaceでデータの扱いはどう違う?

| プラン | 学習利用(デフォルト) | オプトアウト |

|---|---|---|

| Gemini(無料版) | ON(18歳以上のアクティビティ保存がON) | 手動で設定変更が必要 |

| Gemini Advanced(個人有料版) | ON(学習に利用される) | 手動で設定変更が必要 |

| Google Workspace(Business / Enterprise) | OFF(学習に利用されない) | 設定不要 |

| Google Workspace(Education) | OFF(学習に利用されない) | 設定不要 |

Geminiでは「Gemini アプリ アクティビティ」という設定項目が、ChatGPTでいう「学習への利用」に該当します。Google Workspace版はデフォルトで学習に利用されないのが大きな特徴ですが、個人向け(無料・有料とも)はデフォルトでONです。

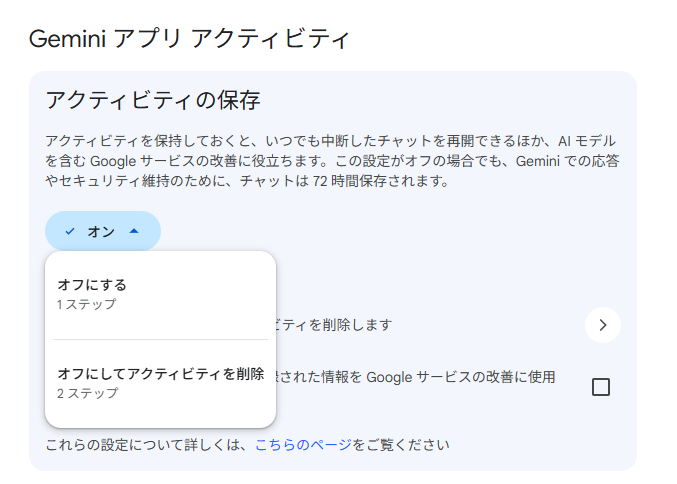

アクティビティ保存をオフにする手順は?

- Geminiを開き、画面左下の設定アイコン(歯車マーク)をクリック

- 「アクティビティ」を選択

- 「Gemini アプリ アクティビティ」の画面で「オフにする」をクリック

- 確認ダイアログが表示されたら「オフにする」または「オフにしてアクティビティを削除」を選択

過去のアクティビティを削除・自動削除期間はどう変える?

過去に保存されたアクティビティの削除や、自動削除期間の変更も可能です。

- 「Gemini アプリ アクティビティ」の画面にある「自動削除オプション」をクリック

- 自動削除期間を選択(推奨は「3か月」、デフォルトは「18か月」)

- 「保存」をクリック

- 過去の履歴を手動で消したい場合は「すべて削除」を選択

オフにしても72時間はデータが残るって本当?

【重要】

Geminiでは、アクティビティ保存をオフにしても、最大72時間はサービス提供やフィードバック処理のためにデータがGoogleのサーバーに保持されます。また、人間のレビュアーが確認したチャット内容は、アクティビティを削除しても最大3年間保持される場合があります。Geminiに機密情報を入力するのは、アクティビティをオフにしていてもリスクがあると思っておいた方がいいですね。

【Claude編】学習・情報の取扱設定を確認しよう

Anthropic社のClaudeは、かつて「デフォルトでユーザーデータを学習に利用しない」ことが大きな特徴でしたが、2025年のポリシー変更でその方針が変わりました。最新の設定を確認しましょう。

無料版/Proと法人版(Team / Enterprise)でデータの扱いはどう違う?

| プラン | 学習利用(デフォルト) | オプトアウト |

|---|---|---|

| Free(無料版) | ON(2025年9月28日以降) | 手動で設定変更が必要 |

| Pro / Max | ON(2025年9月28日以降) | 手動で設定変更が必要 |

| Team | OFF(学習に利用されない) | 設定不要(契約で保証) |

| Enterprise | OFF(学習に利用されない) | 設定不要(契約で保証) |

| API | OFF(学習に利用されない) | 設定不要 |

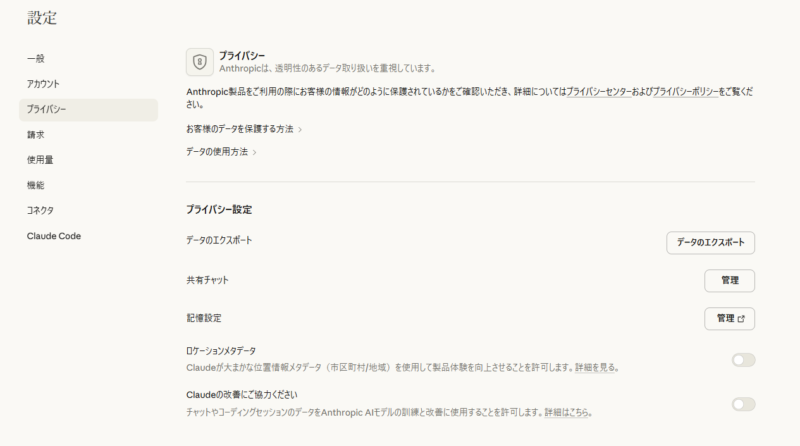

学習させない設定(オプトアウト)はどうやる?

- Claudeにログインし、プロフィールアイコンまたはメニューをクリック

- 「Settings(設定)」を選択

- 「Privacy(プライバシー)」セクションを選択

- 「Help improve Claude(Claudeの改善に協力する)」のトグルをOFFにする

- 設定がグレーアウトされたことを確認して完了

会話履歴の削除と削除後のデータ保持期間は?

- Claudeでは、削除した会話はモデルの学習に使用されません

- オプトアウト設定後のデータ保持期間は最大30日間(サービス提供目的)

- 学習にオプトインした場合、データは最大5年間保持される可能性があります

- フィードバックボタン(👍👎)を押した会話は、その会話分が暗黙的に学習対象となります

- Trust & Safety(信頼・安全性チーム)がフラグを付けたコンテンツは、設定にかかわらず確認・利用される場合があります

2025年のポリシー変更で何が変わった?

Claudeは2025年8月29日に利用規約・プライバシーポリシーを改定し、2025年9月28日から新ポリシーが適用されました。主な変更点は以下のとおりです。

- 変更前:無料版・有料版(Pro)ともに、デフォルトではユーザーデータを学習に利用しない方針

- 変更後:Free / Pro / Maxプランはデフォルトで学習がON(オプトアウトが必要)

- 既存ユーザーには9月28日までにポップアップが表示され、学習への参加可否の選択が求められた

- 一度オプトインすると、過去のデータを遡及的に学習対象から除外することはできない

【注意】

Claudeの個人プランを業務利用している場合は、このポリシー変更の影響を受けます。現在の設定がどうなっているか、必ず確認してください。業務で本格的に利用するなら、Team / Enterpriseプランへの移行を検討した方がいいと思います。

運用面で押さえるべき注意点

オプトアウト設定だけでは十分ではありません。生成AIを安全に業務活用するためには、運用面でも押さえるべきポイントがあります。

①ハルシネーション(AIの誤情報)を前提に動こう

生成AIは、もっともらしい嘘をつくことがあります。これを「ハルシネーション(幻覚)」といいます。経理の仕訳処理や税額の計算でAIが誤った回答をする可能性があるので、丸投げはちょっと危ないですね。

AIの回答は「下書き」や「参考情報」として扱い、最終的な正確性は必ず自分で確認する習慣をつけましょう。

②最終判断は必ず人間が行う(Human-in-the-Loop)

AIが作成した仕訳、計算結果、文章をそのまま使うのではなく、必ず人間が最終確認してから使うというルールを徹底しましょう。この考え方を「Human-in-the-Loop(ヒューマン・イン・ザ・ループ)」といいます。

経理・総務の業務では「AIが言ったから」は言い訳にならないですよね。AIの利用責任は、使用者にあります。

③著作権って大丈夫?

AIが生成した文章や画像には、他者の著作物が含まれている可能性があります。社外向けの文書やプレゼン資料にAIの出力をそのまま使う場合は、著作権侵害のリスクにも注意が必要です。AIの出力はあくまで「たたき台」として活用し、最終的には自分の言葉で書き直すのが安心ですね。

④社内ガイドラインを作って周知しよう

組織で生成AIを安全に活用するには、社内ガイドラインの策定が欠かせません。個人情報保護委員会も2023年6月に「生成AIサービスの利用に関する注意喚起等」を公表し、事業者に対して適切な利用ルールの整備を求めています。

ガイドラインに盛り込むべき主な項目は以下のとおりです。

- 利用を許可するAIサービスの指定(ChatGPT、Gemini、Claudeなど)

- 入力禁止情報の具体的なリスト

- オプトアウト設定の義務化と確認手順

- 個人アカウントでの業務利用の禁止

- AIの出力結果に対する確認・承認フロー

- インシデント発生時の報告・対応フロー

取引先や委託先へのチェックも含めて整理するなら、情報セキュリティチェックのひな形を活用するのが手っ取り早いです。

取引先に対する情報セキュリティチェックのひな形・フォーマット

⑤やってしまった時のインシデント対応フローも決めておく

担当者として一番気になるのは、正直「うっかりやっちゃった時にどうすればいいか」だと思います。誤入力時の対応フローも先に決めておくと、いざという時に動けますね。

- 該当の会話をすぐ削除し、設定がオプトアウトになっているか確認する

- 情報セキュリティ担当・上長へ第一報を入れる(時刻・サービス・入力した情報の概要をメモ)

- 必要に応じて、各サービスのプライバシー窓口にデータ削除申請を出す

- マイナンバーや個人情報など影響範囲が広い場合は、個人情報保護委員会への報告要否も検討する

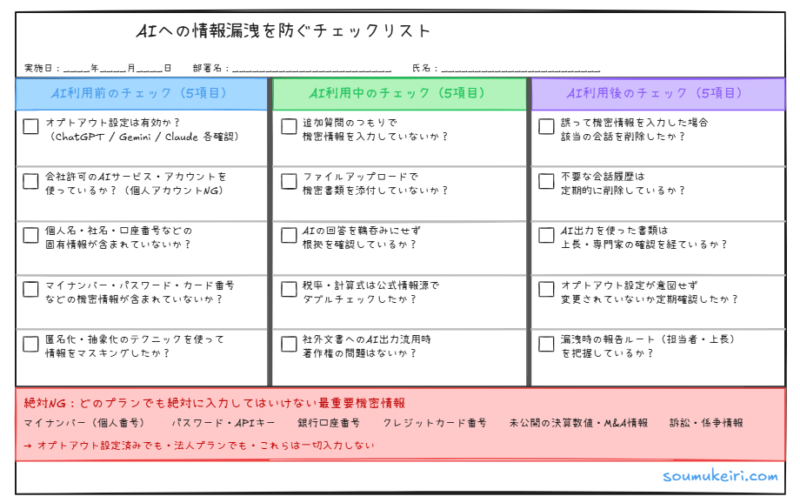

【チェックリスト】AIへの情報漏洩を防ぐチェックリスト

生成AIへの情報漏洩を防ぐチェックリストを用意しました。印刷して手元に置いておくと便利だと思います。

AI利用前のチェック(5項目)

- ☐ オプトアウト設定は有効になっているか?(ChatGPT / Gemini / Claudeそれぞれ確認)

- ☐ 利用しているのは会社で許可されたAIサービス・アカウントか?(個人アカウントでの業務利用はNG)

- ☐ 入力しようとしている情報に、個人名・社名・口座番号などの固有情報は含まれていないか?

- ☐ マイナンバー・パスワード・クレジットカード番号などの機密情報は含まれていないか?

- ☐ 匿名化・抽象化のテクニックを使って情報をマスキングしたか?

AI利用中のチェック(5項目)

- ☐ 会話の中で、追加質問のつもりで機密情報を入力していないか?

- ☐ ファイルのアップロード機能で機密書類を添付していないか?

- ☐ AIの回答内容を鵜呑みにせず、根拠を確認しているか?

- ☐ 税率や計算式は公式情報源でダブルチェックしたか?

- ☐ AIの回答をコピーして社外文書に貼り付ける際、著作権の問題はないか?

AI利用後のチェック(5項目)

- ☐ 誤って機密情報を入力してしまった場合、該当の会話を削除したか?

- ☐ 不要な会話履歴は定期的に削除しているか?

- ☐ AIの出力を使った書類は、上長や専門家の確認を経ているか?

- ☐ オプトアウト設定が意図せず変更されていないか、定期的に確認しているか?

- ☐ 万が一の漏洩に備え、情報セキュリティ担当や上長への報告ルートを把握しているか?

よくある質問(Q&A)

- オプトアウトしてあれば、何を入れても安全なの?

-

いいえ。オプトアウトは「学習への利用を停止する」設定であり、データの完全な消去を保証するものではありません。オプトアウト後もサーバーに一定期間データが保持されますし、セキュリティインシデントによる漏洩リスクは残ります。マイナンバーやパスワードなどの最重要機密情報は、オプトアウト設定にかかわらず入力しない方が安全だと思います。

- うっかり機密情報を入れちゃった!どうすればいい?

-

まず、該当する会話を速やかに削除してください。次に、オプトアウト設定がONになっていなければすぐにONにしましょう。それでも設定変更前のデータはすでに学習に使用されている可能性があるため、ChatGPTの場合はOpenAIのプライバシーリクエストポータル(https://privacy.openai.com/)からデータ削除申請を行うことも検討してください。漏洩した情報の内容によっては、社内のセキュリティ担当や上長への報告も必要になります。

- 法人版プラン(Team / Enterprise)なら完全に安全?

-

法人版プランでは入力データがAIの学習に使用されないことが契約上保証されており、セキュリティレベルは大幅に向上します。ただし、「完全に安全」とまでは言えないですね。サービス提供者側のシステム障害やバグ(2023年のChatGPTバグ事例など)のリスクはゼロにはできないため、マイナンバーやパスワードなどの最重要機密情報は法人版でも入力を避けるのが安全だと思います。

- 経理でAIを使うメリットが大きい業務って何?

-

機密情報を含まない範囲で活用すると効果的ですね。例えば、勘定科目の選び方の確認、一般的な仕訳パターンの質問、税務知識の学習、Excelの関数やVBAの作成支援、社内マニュアルの文章校正、ビジネスメールの下書きなどが挙げられます。「AIに聞くときは固有名詞を消す」を徹底すれば、業務効率は大きく向上します。

- ChatGPT・Gemini・Claudeの中で、セキュリティ面で最も安全なのはどれ?

-

一概にどれが最も安全とは言えないですね。3サービスとも、法人向けプランでは入力データの学習利用をしない方針です。個人向けプランではいずれもデフォルトで学習がONであり、オプトアウト設定が必要な点も共通しています。サービスごとのデータ保持期間や設定方法には違いがあるため、自社の利用状況に合わせて比較検討するのがいいと思います。

- AIへの入力って、個人情報保護法の「第三者提供」になるの?

-

個人情報保護委員会は2023年6月に「生成AIサービスの利用に関する注意喚起等」を公表し、AIサービスへの個人情報の入力について注意を促しています。入力した個人情報がAIの学習に利用される場合、「第三者提供」や「目的外利用」に該当する可能性があり、個人情報保護法への抵触リスクがあります。業務で個人情報を扱う場合は、オプトアウト設定を行うか、個人情報を入力しない運用を徹底しましょう。

- スマホアプリ版でもオプトアウトは必要?

-

はい、必要です。スマートフォンアプリ版でもWeb版と同様に、デフォルトでは入力データが学習に利用されます。PC(Web版)でオプトアウト設定を行えばアプリ版にも反映されますが、念のためアプリ側でも設定状況を確認するのが安心ですね。

- 「一時的なチャット」を使えば学習されないの?

-

ChatGPTには「Temporary Chat(一時的なチャット)」機能があり、この機能を使った会話は学習に利用されません。ただし、会話が終了すると内容は削除されるため、後から振り返ることができません。一時的な質問には有効ですが、毎回この機能を使う手間を考えると、根本的にはオプトアウト設定を行ったうえで通常利用するのが現実的だと思います。

- 社内ガイドラインを作るとき、参考になる公的資料はある?

-

以下の公的資料が参考になります。個人情報保護委員会「生成AIサービスの利用に関する注意喚起等」(2023年6月)、総務省・経済産業省「AI事業者ガイドライン」(2024年4月)、日本ディープラーニング協会(JDLA)「生成AIの利用ガイドライン」などです。いずれも各公式サイトから無料で閲覧・ダウンロードできます。

まとめ

生成AIは経理・総務の業務効率化に大きな力を発揮しますが、使い方を誤ると重大な情報漏洩につながります。本記事の要点を整理します。

- 経理・総務は機密性の高い情報を日常的に扱う部門であり、生成AIの利用には特別な注意が必要

- 一度AIに入力した情報は完全には取り消せない。「インターネットに公開した」のと同じ意識を持つ

- マイナンバー・パスワード・口座番号・未公開決算情報などは、絶対にAIに入力しない

- 入力テクニック(匿名化・抽象化・法人プラン活用)を使えば、安全にAIを活用できる

- ChatGPT・Gemini・Claudeいずれも、無料版・個人版はデフォルトで学習ON → オプトアウト設定が必須

- オプトアウト後もデータは一定期間保持される(ChatGPT:最大30日、Gemini:最大72時間、Claude:最大30日)

- AIの出力は必ず人間が最終確認する(Human-in-the-Loop)

- 社内ガイドラインの策定・周知と、利用前チェックリストの活用が組織的なリスク対策の鍵

最初の設定さえ押さえておけば、AIは経理・総務の頼れる相棒になりますので、ぜひ社内でルール化して活用してみてください。